При бесконтрольном развитии искусственного интеллекта мир может оказаться в ситуации, схожей с гонкой ядерного вооружения, предупреждает в статье для Foreign Affairs бывший госсекретарь США Генри Киссинджер. Вот только времени на реакцию сегодня гораздо меньше. А для начала надо понять, чем ИИ принципиально отличается от ядерного оружия. «БИЗНЕС Online» подготовил перевод статьи.

Пугающие технологии

В этом году исполняется 78 лет с окончания самой кровопролитной войны в истории, а еще мирного существования всех сверхдержав. Первую мировую войну и Вторую разделяло чуть больше 20 лет, а ожидание третьей, которая уже может уничтожить все человечество, вылилось в несколько десятилетий холодной войны. Когда Япония сдалась после атомных бомбардировок Хиросимы и Нагасаки, мало кто предполагал, что де-факто это наложит мораторий на использование ядерного оружия на следующие 70 лет. А еще мало кто предполагал, что к этому моменту в мире будет всего 9 ядерных держав. Под лидерством Америки мы избежали ядерной войны, ограничили распространение ядерного оружия и установили мир между сверхдержавами. Все это одни из величайших достижений Штатов.

А сегодня мир предстает перед вызовами еще более пугающей технологии — искусственного интеллекта (ИИ) — и в попытках найти какое-то руководство обращается к истории. Станут ли машины новыми повелителями мира? Оспорит ли ИИ монополию наций на насилие? Даст ли ИИ кому-то из нас возможность разрабатывать смертоносные вирусы, которые убьют стольких людей, скольких супердержавы не смогли бы при всем желании? Разрушит ли ИИ нашу систему ядерного сдерживания, которая лежит в основе современности?

Сейчас никто не может ответить на эти вопросы. Но мы исследовали их с группой лидеров в сфере ИИ, и нам представляется, что бесконтрольное развитие этой отрасли может иметь катастрофические последствия для США и всего мира. Так что лидеры государств должны действовать сейчас. Пусть никто из них (и никто из нас) не может в точности прогнозировать будущее, мы поняли достаточно, чтобы принимать тяжелые решения здесь и сейчас.

Мировым лидерам может помочь опыт ядерного оружия. Он показал, что общие интересы можно найти даже в гонке вооружений, способной убить миллионы людей. США и СССР понимали, что их технологии могут попасть в руки террористам из других стран, так что обезопасили свои арсеналы. А еще они понимали, что террористы могли получить технологии с подачи либо США, либо СССР. Так что они начали взаимодействовать друг с другом, чтобы этого не случилось.

А как только технологии достигли такого уровня, что ядерные удары одной стороны немедленно спровоцировали бы удары другой, появился термин «Взаимное гарантированное уничтожение». С этого момента державы стали всеми силами избегать крупных столкновений. Лидеры США и Штатов сочли, что их главная обязанность — предотвратить ядерную войну, первой жертвой которой стали бы их народы.

Искусственный интеллект — это не вторая глава ядерной эпохи, а история — это не поваренная книга, откуда можно достать готовый рецепт. Отличий между ИИ и ядерным оружием так же много, как и общего. И тем не менее важно изучить принципы, по которым мир за почти 80 лет так и не увидел прямой войны между сверхдержавами.

К этому моменту в мире всего два лидера в сфере ИИ — это США и Китай. Только у них есть достаточно специалистов, научно-исследовательских институтов и технологий, чтобы разрабатывать самые сложные модели искусственного интеллекта. И только они могут предотвратить сценарий, когда ИИ будет использоваться в самых плохих целях. Президенту США Джо Байдену и китайскому лидеру Си Цзиньпину нужно провести саммит — возможно, сразу после их встречи в Сан-Франциско в ноябре — и развернуто обсудить там один из самых важных вопросов перед ними сегодня.

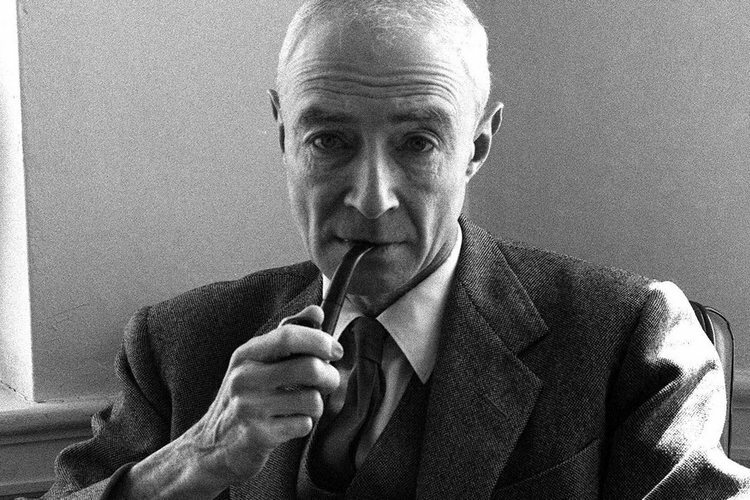

Роберт Оппенгеймер, глава Манхэттенского проекта, цитировал «Бхагавад Гиту»: «Я стал смертью, разрушителем миров»

Роберт Оппенгеймер, глава Манхэттенского проекта, цитировал «Бхагавад Гиту»: «Я стал смертью, разрушителем миров»

Уроки ядерной эпохи

Когда атомные бомбы уничтожили японские города в 1945 году, ученые, открывшие ящик Пандоры, с ужасом наблюдали за своим творением. Роберт Оппенгеймер, глава Манхэттенского проекта, цитировал «Бхагавад Гиту»: «Я стал смертью, разрушителем миров». Он призывал к настолько радикальным мерам по ядерному сдерживанию, что попал в опалу спецслужб. Об опасностях нового оружия мировые лидеры узнали из манифеста Бертрана Рассела и Альберта Эйнштейна, который в 1955 году подписали 11 крупнейших ученых — это не только Рассел и Эйнштейн, но и Линус Паулинг и Макс Борн.

Ни президент США Гарри Трумэн, ни его команда не понимали, как новая технология должна вписаться в новый послевоенный миропорядок. Надо ли США сохранять атомную монополию? Возможно ли это? Имеет ли Штатам смысл поделиться своими ядерными наработками с Советским Союзом? Требует ли это оружие новой международной организации, которая стояла бы выше государств? Военный советник Трумэна Генри Стимсон (который только что помог победить Германию и Японию) предложил Штатам поделиться атомными бомбами с советским лидером Иосифом Сталиным и британским премьером Уинстоном Черчиллем. В его понимании так можно было бы предотвратить распространение ядерного оружия за пределы троицы.

Трумэн даже создал комитет, который возглавлял госсекретарь США Дин Ачесон. Он должен был проработать предложение Стимсона. Ачесон был согласен со Стимсоном в одном: гонка ядерных вооружений не приведет к ужасной войне только при одном условии — если атомные бомбы перейдут под контроль международной организации. Это потребует от США поделиться своими секретами с Советским Союзом и другими членами совета безопасности ООН, раскрыть свой арсенал для новой атомной организации и запретить всем остальным странам разрабатывать свое оружие или сооружать нужную для этого инфраструктуру. В 1946 году Труман отправил своего советника Бернарда Баруха в ООН, чтобы обсудить план Ачесона. От предложения категорически отказался представитель СССР Андрей Громыко.

Через три года Советский Союз уже разработал свою бомбу. Мир вступил в эпоху холодной войны — соревнования между СССР и США за пули, ракеты и, конечно, ядерное превосходство. За последнее шла самая ожесточенная борьба. На своем пике арсеналы сверхдержав достигали 60 тыс. боеголовок. Часть из них была мощнее, чем все использованное ранее оружие во всех войнах. Эксперты стали обсуждать, положит ли ядерная война конец каждой человеческой жизни на планете.

Госсекретарь США Дин Ачесон настаивал, что США поделился ядерными технологиями с СССР и другими членами совбеза ООН

Госсекретарь США Дин Ачесон настаивал, что США поделился ядерными технологиями с СССР и другими членами совбеза ООН

Десятилетиями Вашингтон и Москва вкладывали триллионы долларов в свои ядерные арсеналы. Даже текущий бюджет США на ядерную индустрию — $50 млрд в год. Штаты и Союз достигли небывалых до этого высот ради первенства в этой гонке. Для новых бомб потребовались новые единицы измерения: от килотонн (а один килотонна — это как энергия от тысячи пачек динамита) к мегатоннам (это как 1 млн т динамита). А еще для бомб разработали ракеты, которые могли долететь до другого полушария за 30 минут, спутники, которые могут установить координаты цели в точности до миллиметров, и системы реагирования, которые мгновенно ответили бы ударом на удар. Кто-то надеялся, что эти системы сделают ядерное оружие, как говорил президент Рональд Рейган, «устаревшим и бессильным».

Новое вооружение

Чтобы придать этим процессам форму, аналитики разработали новые концепции. Они описали основные требования для ответного удара. Они создали ядерную триаду — подлодки, бомбардировщики и наземные установки. Если какой-то из этих элементов даст сбой, другие будут готовы для ответа. Они разработали систему защиты от случайного или умышленного пуска. Без нужных кодов ракеты теперь не запустить. Целая компьютерная сеть стала защищать систему управления от взлома. Впоследствии эти разработки помогли в создании интернета. Как говорил футуролог Герман Кан, они «мыслили о немыслимом».

В центре ядерной стратегии оказалась политика сдерживания. Ты сдерживаешь своего соперника, если можешь ответить ему. Тем самым ты лишаешь соперника любой выгоды от возможного удара. Но вскоре стало понятно, что для успешного сдерживания нужно еще и доверие. Ведь для ответа потенциальной жертве нужна не просто технология, а желание ею воспользоваться им. В этот процесс стали включать политические механизмы, создавать альянсы и убеждать другие страны не создавать свои ядерные арсеналы.

В 1962 году, когда президент США Джон Кеннеди схлестнулся с советским лидером Никитой Хрущевым по вопросу ядерных ракет на Кубе, американские спецслужбы провели подсчеты. Выяснилось, что если Кеннеди нанесет успешный первый удар, то ответ Советов уничтожит 62 млн американцев. В 1969 году, когда Ричард Никсон стал президентом, США пришлось поменять свои подходы. Один из наших авторов, Генри Киссинджер, описал этот процесс так: «Наши оборонные стратегии сформировались в период нашего доминирования. Их нужно пересмотреть из-за новых вызовов. Никакая военная риторика не отменит того факта, что наших ядерных потенциалов хватит для уничтожения человечества. Наш долг — предотвратить ядерную катастрофу».

Настало время ироничного термина «взаимное гарантированное уничтожение» (ВГУ), который описал Рейган своей фразой: «В ядерной войне нельзя победить, так что ее не надо развязывать». В мире ВГУ все стали уязвимы. США и Советский Союз пытались оспорить это, но быстро поняли, что невозможно и что теперь нужно восстанавливать отношения между странами. В 1955 году Черчилль заметил с запредельной иронией: «Безопасность будет порождена террором, а выживание — близнец уничтожения». С пониманием, что их принципиальные различия никуда не делись, и без ущемления своих национальных интересов смертельные враги стали думать, как избежать полномасштабной войны.

Рейган и Горбачев заключили договор о ликвидации ракет средней и меньшей дальности

Рейган и Горбачев заключили договор о ликвидации ракет средней и меньшей дальности

Один из шагов — скрытые и публичные меры, известные сегодня как «Контроль над вооружениями». Даже до эпохи ВГУ, когда каждая страна делала все возможное для своего превосходства, они находили общие интересы. Чтобы снизить риски, США и СССР негласно договорились не вмешиваться в страны из сферы своих прямых интересов. Чтобы спасти своих жителей от радиоактивных осадков, они запретили тесты бомб в небе. Чтобы избежать ситуации, когда одна сторона решает атаковать, уверенная, что другая вот-вот собирается это сделать, в 1972 году был подписан Договор о противоракетной обороне. В 1987-м Рейган и Михаил Горбачев заключили договор о ликвидации ракет средней и меньшей дальности. Переговоры об ограничении стратегических вооружений привели к соглашениям 1972 и 1979 годов, они уменьшили число ракетных установок. Затем последовали договоры об ограничении стратегических вооружений 1991 и 2010 года. Наиболее последовательны США и СССР были в том, что не дали ядерному оружию разойтись в другие страны. В конечном счете стороны пришли к договору о нераспространении ядерного оружия 1968 года, по которому 186 стран пообещали не разрабатывать свои арсеналы. Так державы предотвратили ядерную анархию.

Контроль над искусственным интеллектом

Сегодняшние предложения по контролю ИИ отсылают нас к прошлому. Миллиардер Илон Маск требует остановить на полгода все разработки, исследователь ИИ Элиезер Юдковский предложил вообще запретить ИИ, психолог Гэри Маркус считает нужным создание новой международной организации, которая контролировала бы ИИ. Все это напоминает предложения из прошлого по сдерживанию ядерного оружия. Они не воплотились в жизнь потому, что нарушали суверенитет стран. Еще ни одна страна в истории, зная, что враг овладел технологией, которая может их уничтожить, не отказывалась от разработки этой же технологии. Даже близкие союзники США Великобритания и Франция разработали свои программы, лишь согласившись быть под ядерным зонтиком американцев.

Чтобы учесть уроки ядерного прошлого, нужно определить, в чем ИИ принципиально отличается от ядерного оружия. Во-первых, бомбы разрабатывали государства, а над ИИ работает частный сектор. Кадры в Microsoft, Google, Amazon, Meta*, OpenAI и других компаниях на порядок опережают государственные. Более того, между названными гигантами разворачивается настоящая конкурентная борьба. Она способствует инновациям, но вряд ли учитывает национальные интересы.

Во-вторых, ИИ работает в цифровом формате. Ядерное оружие было тяжело разработать, требовались сложнейшие технологии для добычи урана и изготовления бомб. На выходе мы получали конкретный продукт, его количество можно было подсчитать. А если у врага продукт был лучше, это можно было установить. ИИ — это другая история. У него нет физического аналога. Его разрабатывают в лабораториях. За его развитием не так уж легко уследить. Ядерное оружие реально, а ИИ виртуален.

Ядерное оружие реально, а ИИ виртуален

Ядерное оружие реально, а ИИ виртуален

В-третьих, ИИ прогрессирует с такой скоростью, что длительные переговоры здесь уже не к месту. Военные доктрины принимались десятилетиями. А политика по ИИ должна быть определена еще до того, как ИИ станет частью системы безопасности какой-либо из стран. То есть это должно произойти до момента, как машины начнут принимать самостоятельные решения — некоторые эксперты полагают, что случится это уже на отрезке в пять лет. В кратчайшие сроки нужно обсудить вопрос на национальном, а затем и межнациональном уровне, а также установить новый порядок отношений государства и частного сектора.

К счастью, IT-гиганты, которые сделали США лидером в сфере искусственного интеллекта, понимают свою ответственность не только перед акционерами, но и перед страной и всем человечеством. Многие уже самостоятельно разработали методички, как предотвращать риски, лучше структурировать данные и исключить опасное использование своих ИИ-моделей. Другие же ищут способ, как ограничивать тестирование своих ИИ-моделей и ограничивают облачных провайдеров. Отличным шагом была июльская встреча Байдена с главами 7 ИИ-компаний в Белом доме. Там были приняты документы, которые бы гарантировали «безопасность, защиту и доверие.

Как заметил один из наших авторов, Киссинджер в своей работе «Эпоха ИИ», важно систематически следить за развитием ИИ, предвещать самые смелые открытия в этой сфере и самые неожиданные области его применения. Пусть США сейчас переживает сильнейший раскол внутри страны со времен гражданской войны, риски бесконтрольного применения ИИ обязывают бизнес и государство действовать сейчас. Все компании с мощностями для разработки новых ИИ-моделей должны создать рабочую группу и проанализировать последствия своих коммерческих операций для стран и всего человечества.

С новым вызовом не справиться в одиночку. Президент и конгресс должны основать национальную комиссию. Туда должны войти бывшие участники частного сектора, не связанные ни с одной из компаний ныне. Также туда должны войти представители конгресса, армии и спецслужб. Комиссия должна предоставить гарантии по безопасности. Она должна оценивать технологии, которые позволяют разрабатывать такие ИИ-модели, как GRT-4, тестировать каждую модель них перед выпуском.

И пусть разработка таких мер — задача не из легких, у нас есть пример перед глазами — это комиссия нацбезопасности по искусственному интеллекту. Ее рекомендации от 2021 года как раз дали импульс и направление армии и спецслужбам в их соперничестве с Китаем в области ИИ.

Две ИИ-сверхдержавы

Даже сейчас, когда США еще только очерчивает рамки ИИ у себя в стране, можно начинать переговоры в международном поле с единственной другой сверхдержавой в этом секторе. Чемпионы Китая в сфере IT — Baidu (главный поисковик страны), ByteDance (создатели TikTok), Tencent (создатели WeChat) и Alibaba (главный интернет-ретейлер) — прямо сейчас создают свой аналог ChatGPT, хотя китайская политическая система и затрудняет им этот процесс. Прямо сейчас у Китая не хватает мощностей для своих нейросетей, но у них есть достаточный потенциал, чтобы заполучить их.

Так что Байден и Си должны как можно раньше встретиться и обсудить, как контролировать сферу ИИ-вооружений. Ноябрьская встреча Азиатско-Тихоокеанского экономического сотрудничества в Сан-Франциско дает возможность для этого. Каждый из лидеров должен рассказать, как он оценивает риски от ИИ, что его страна делает для предотвращения катастрофы и в чем контролирует свои компании. А чтобы общение по этим вопросам продолжилось в будущем, им нужно создать рабочую группу из американских и китайских специалистов в области ИИ и других участников сферы. Этот подход реализуют в других областях уже без участия государства. Из наших разговоров с представителями обоих государств мы уверены, что такая коммуникация будет крайне продуктивной.

США и Китай лишь часть международных обсуждений по ИИ. В ноябре Великобритания примет саммит безопасности в ИИ, планируется диалог в ООН. Каждая страна постарается внедрить ИИ для повышения уровня жизни своих граждан, так что в долгосрочной перспективе понадобится система международного регулирования ИИ. Первый шаг в ее становлении — установить самые опасные и катастрофические последствия ИИ. Нужные инициативы могут родиться в результате общения специалистов разных стран, занятых в секторе ИИ, и представителей региональных комиссий — наподобие той, что мы предложили здесь. В результате должна появиться структура, похожая на Международное агентство по атомной энергии.

Если Байден, Си и другие мировые лидеры начнут действовать сейчас, чтобы достойно встретить все вызовы ИИ, как их предки достойно встретили вызовы ядерного оружия, будут ли они так же успешны? С учетом исторических раскладов и сильных противоречий в мире сейчас тяжело дать оптимистичный прогноз. Но тот факт, что мы 78 лет живем в мире между ядерными державами, должен вдохновить нас на достойный ответ вызовам искусственного интеллекта.

Генри Киссинджер и Грэм Эллисон / Foreign Affairs

Перевод: Артур Валеев

*запрещенная в России экстремистская организация